Google anunció el lanzamiento de Gemini 2.0, su modelo de inteligencia artificial más avanzado hasta el momento. Diseñado para la era de los agentes inteligentes, este sistema incorpora capacidades multimodales como la comprensión de texto, imágenes, audio y contexto espacial, permitiendo interacciones más dinámicas.

El modelo está destinado a ser la base de los agentes de inteligencia artificial, herramientas diseñadas para asistir en tareas complejas. Gemini 2.0 no solo procesa información textual, sino que puede interpretar lo que observa y realizar tareas específicas a partir de esa información.

"Gemini 2.0 es nuestro modelo de IA más capaz hasta el momento, creado para la era de los agentes de IA. Gemini 2.0 ofrece un rendimiento mejorado y nuevas capacidades como el audio multilingüe", ha explicado en una llamada con la prensa Tulsee Doshi, jefe de producto del modelo Gemini en Google.

Cómo usar Gemini 2.0: hacé que la IA vea lo que hacés

Por ahora, Google ha lanzado -en vista previa "experimental", y solo para Gemini Advanced y desarrolladores en Al Studio y Vertex Al- Gemini 2.0 Flash, herramienta de IA que según la compañía es el doble de rápida y potente que su versión anterior.

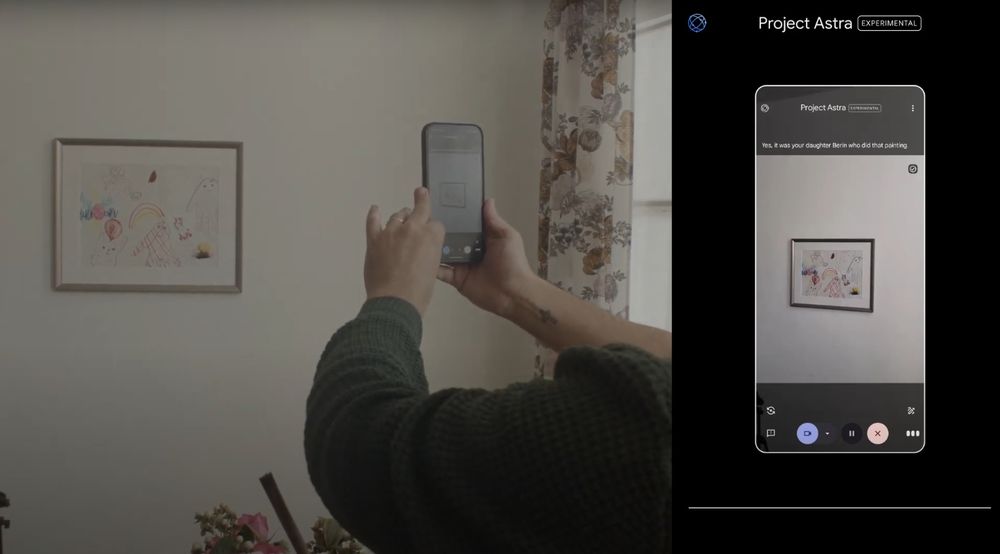

El gigante informático lanzó Project Astra, un asistente digital para teléfonos inteligentes que puede entender fotos, videos y texto, así como comandos verbales -los usuarios podrán incluso mezclar idiomas a mitad de una conversación- y cuya gran novedad es que tiene "memoria". La tecnología es capaz de recordar hasta 10 minutos de la conversación actual.

Aquellos que tengan acceso pueden comenzar a explorar sus capacidades a través de Google AI Studio, donde se ofrecen tres modalidades principales:

- Talk to Gemini: permite interactuar por micrófono en tiempo real.

- Show Gemini: analiza lo que el usuario está viendo a través de la cámara y brinda retroalimentación.

- Share your screen: interpreta lo que ocurre en la pantalla para asistir con tareas específicas.

Estas funcionalidades son un avance hacia asistentes inteligentes capaces de interpretar información visual y adaptarse a necesidades complejas en tiempo real.

"Hemos mejorado la capacidad del Proyecto Astra para recordar cosas. Ahora tiene hasta 10 minutos de memoria en sesión y también puede recordar conversaciones que se hayan tenido con él en el pasado, para que se pueda conseguir una experiencia personalizada más útil", ha comentado a la prensa Bibo Xu, gerente principal de productos de Google DeepMind para el Proyecto Astra.

Primeras experiencias con Gemini 2.0

En redes sociales, algunos usuarios han comenzado a compartir sus primeras pruebas con Gemini 2.0. Por ejemplo, un usuario mostró cómo la IA lo ayudó en tiempo real a comprender un texto de una investigación académica, desglosando información compleja en puntos más claros.

Otro usuario demostró cómo el sistema pudo identificar elementos de un video para ofrecer contextos adicionales y explicaciones sobre lo que estaba viendo. Estas experiencias iniciales reflejan el potencial de Gemini 2.0, aunque también revelan limitaciones en tareas más específicas.

En una prueba realizada por El Observador, se constató que Gemini 2.0 puede entender conceptos básicos sobre lo que observa, como reconocer elementos o responder preguntas simples. Sin embargo, mostró dificultades en tareas más complejas: por ejemplo, al intentar identificar la nacionalidad de una marca basada en su logotipo, cometió errores.

WhatsApp Video 2024-12-11 at 11.10.36 PM.mp4

Desde Google, subieron videos mostrando cómo puede ayudar a los usuarios en la vida cotidiana (puede asesorar en tiempo real cómo mejorar una receta que está haciendo en vivo analizando lo que está cocinando), o también ayudarlo en un videojuego para emplear otras estrategias. Abajo los videos:

Embed - Project Astra early access demo | Using AI as a creative tool

Embed - Gemini 2.0 for games demo | Playing Squad Busters, Clash of Clans, and Hay Day

Proyecto Mariner: IA en navegadores web

Uno de los experimentos más destacados que utiliza Gemini 2.0 es el Proyecto Mariner, un prototipo diseñado para trabajar dentro de navegadores como Chrome. Este agente es capaz de realizar acciones como búsquedas, compras en línea o reservas de billetes de avión, simplificando tareas diarias desde el navegador.

Según Google, el agente puede desplazarse, escribir y hacer clic en las pestañas activas. Aunque todavía es un prototipo en desarrollo, ya demuestra que es posible integrar la IA en navegadores. Sin embargo, tiene limitaciones: es lento y no siempre preciso.

Para garantizar la seguridad de los usuarios, Mariner solicita confirmación antes de ejecutar acciones sensibles, como realizar compras. Esto asegura que los humanos mantengan el control sobre las decisiones que toma la IA.